تطورت احتياجات السلامة الأساسية مع بداية الثورات الصناعية والمعرفية، أصبح تعاملنا أقل مع المواد الخام، وأوسع بكثير مع الآلات. يتطلب التعاون الآمن مع البشر تخطيطًا منهجيًا وتنسيقًا، لأن الروبوتات لا تتمتع بالوعي السلوكي المبرمج والتحكم ذاته. قد تفترض أن صديقك يمكنه ملء كأس قهوتك الصباحية دون أن ينسكب عليك، لكن بالنسبة إلى روبوت، تتطلب هذه المهمة البسيطة ظاهريًا ملاحظة دقيقة وفهمًا للسلوك البشري.

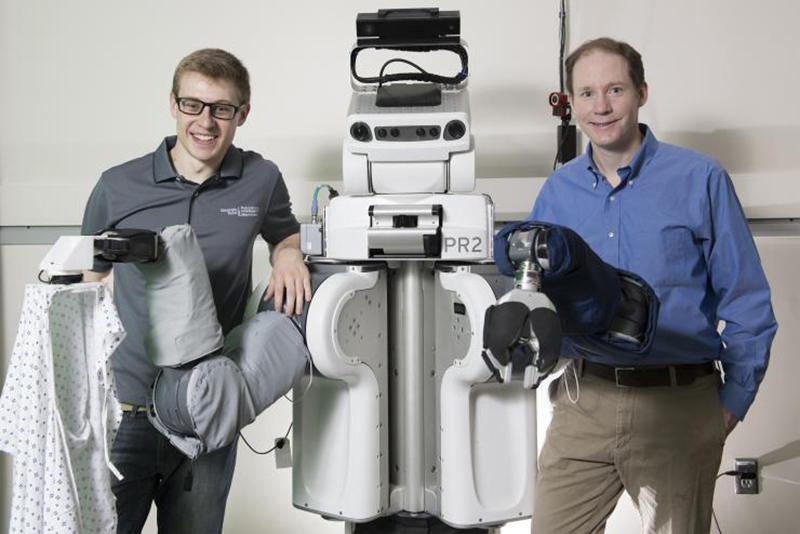

أنشأ علماء من مختبر علوم الحاسوب والذكاء الصناعي في معهد ماساتشوستس للتكنولوجيا خوارزمية جديدة تمكن الروبوت من إيجاد خطط حركة فعالة تضمن السلامة البدنية لنظيره البشري. ساعد الروبوت -في هذه الحالة- بشريًا في ارتداء سترة، قد يثبت ذلك أهميته بوصفه أداة قوية لتوسيع المساعدة لتشمل ذوي الاحتياجات الخاصة أو محدودي الحركة.

قال طالب الدكتوراه في معهد ماساتشوستس للتكنولوجيا شين لي، المؤلف الرئيس للبحث الجديد: «إن تطوير خوارزميات لمنع الأذى البدني دون التأثير في المهمة يُعدّ تحديًا حاسمًا. قد تجد طريقتنا مسارات آلية فعالة لإلباس البشر مع ضمان السلامة، بالسماح للروبوتات بالتواصل الآمن مع البشر».

النمذجة البشرية والسلامة والفعالية:

النمذجة البشرية المناسبة، أي كيفية تحرُّك البشر وتفاعلهم واستجابتهم، ضرورية لتمكين خطط حركة آلية ناجحة في مهمات تفاعل الروبوتات مع البشر. قد يحقق الروبوت تواصلًا متقنًا إذا كان النموذج البشري مثاليًا، لكن في العديد من الحالات، لا يوجد مخطط لا تشوبه شائبة.

سيكون الروبوت المُرسل إلى منزل شخص ما ذا نموذج «افتراضي» محدود للغاية عن كيفية تفاعل البشري معه في أثناء عملية المساعدة في ارتداء الملابس ، ولن يفسر التفاوت الواسع في ردود الأفعال البشرية اعتمادًا على عدد كبير من المتغيرات كالعادات والشخصية.

تختلف ردة فعل طفل صغير عند ارتداء معطف أو قميص عنها لدى شخص عجوز وضعيف، أو عن ذوي الاحتياجات الخاصة الذين قد يعانون إرهاقًا سريعًا أو براعة منخفضة.

إذا كان الروبوت مكلفًا بالمساعدة على ارتداء الملابس، ويخطط لمسار استنادًا إلى ذلك النموذج الافتراضي فقط، عندها قد يصطدم بالبشري ببلاهة، مُسببًا تجربة غير مريحة أو حتى إصابة محتملة. أما إذا كان الروبوت متحفظًا جدًا في ضمان السلامة، فقد يفترض بتشاؤم أن المساحة حوله غير آمنة ويفشل بالتحرك، وهي مشكلة تُسمى «الروبوت المتجمد».

تدرس خوارزمية الفريق الشك لدى النموذج البشري، لتوفير ضمان نظري للسلامة البشرية. بدلًا من وجود نموذج افتراضي وحيد يدرك الروبوت وفقًا له ردة فعل محتملة واحدة فقط، زوّد الفريق الآلة بفهم للعديد من النماذج الممكنة، لمحاكاة أقرب لكيفية فهم البشر بعضهم بعضًا. كلما جمع الروبوت معلومات أكثر، يتناقص الشك وتُصقل تلك النماذج.

أعاد الفريق تعريف السلامة لمخططات حركة الوعي البشري بأنها تجنب الاصطدام، أو تأثير آمن حال حدوث تصادم. غالبًا، لا يمكن تفادي التصادم نهائيًا، لا سيما في مهام أنشطة المعيشة اليومية بمساعدة الروبوت. سمح ذلك للروبوت بالقيام بتواصل غير مؤذ مع البشر لإحراز تقدم، ما دام تأثير الروبوت في البشري محدودًا. مع تعريف الأمان ذي الشقين، بوسع الروبوت إتمام مهمة المساعدة على ارتداء الملابس بأمان وفي وقت أقصر.

لنفترض مثلًا وجود نموذجين محتملين لكيفية ردة فعل بشري تجاه ارتداء الملابس. «النموذج الأول» هو أن البشري يتحرك إلى أعلى في أثناء ارتداء الملابس، أما «النموذج الثاني» فهو أن البشري يتحرك إلى أسفل. يضمن الروبوت -بفضل خوارزمية الفريق- سلامة كلا النموذجين، بدلًا من اختيار نموذج واحد عندما يخطط للحركة. سيكون المسار المحدد آمنًا مهما كانت حركة البشري، إلى أعلى أو إلى أسفل.

تركز الجهود المستقبلية على دراسة المشاعر الذاتية للسلامة، إضافةً إلى العوامل الجسدية في أثناء ارتداء الملابس بمساعدة الروبوت، لرسم صورة أشمل لهذه التفاعلات.

قال الأستاذ المساعد في معهد الروبوتات في جامعة كارنيجي ميلون، زاكري إريكسن: «يجمع هذا النهج متعدد الأوجه نظرية المجموعات وقيود أمان الإدراك البشري وتوقعات الحركة البشرية، ومراقبة ردود الفعل من أجل تواصل بشري آلي آمن».

«يمكن تطبيق هذا البحث على مجموعة واسعة من سيناريوهات الروبوتات المساعدة، نحو الهدف النهائي المتمثل في تمكين الروبوتات من تقديم مساعدة جسدية أكثر أمانًا لذوي الاحتياجات الخاصة».

اقرأ أيضًا:

بإمكان هذه الروبوتات أن تعيد الأموات إلى الحياة

حين تسرق الروبوتات وظائفنا، من سيكون أكبر الخاسرين؟

ترجمة: ربيع شحود

تدقيق: حسين جرود